Человек, который сам создает роботов, дал несколько советов российским сенаторам насчет законопроекта об отношениях человека и машины. Документ запрещает «иноагентам» получать соответствующие лицензии, а самим роботам — принимать решения (не наоборот).

Сенатор от Петербурга Андрей Кутепов написал законопроект, который, по выражению ТАСС, «закрепляет принципы взаимоотношений робота и человека». Сами машины делят на «гражданских» и «служебных», селекцией займётся «федеральный орган исполнительной власти».

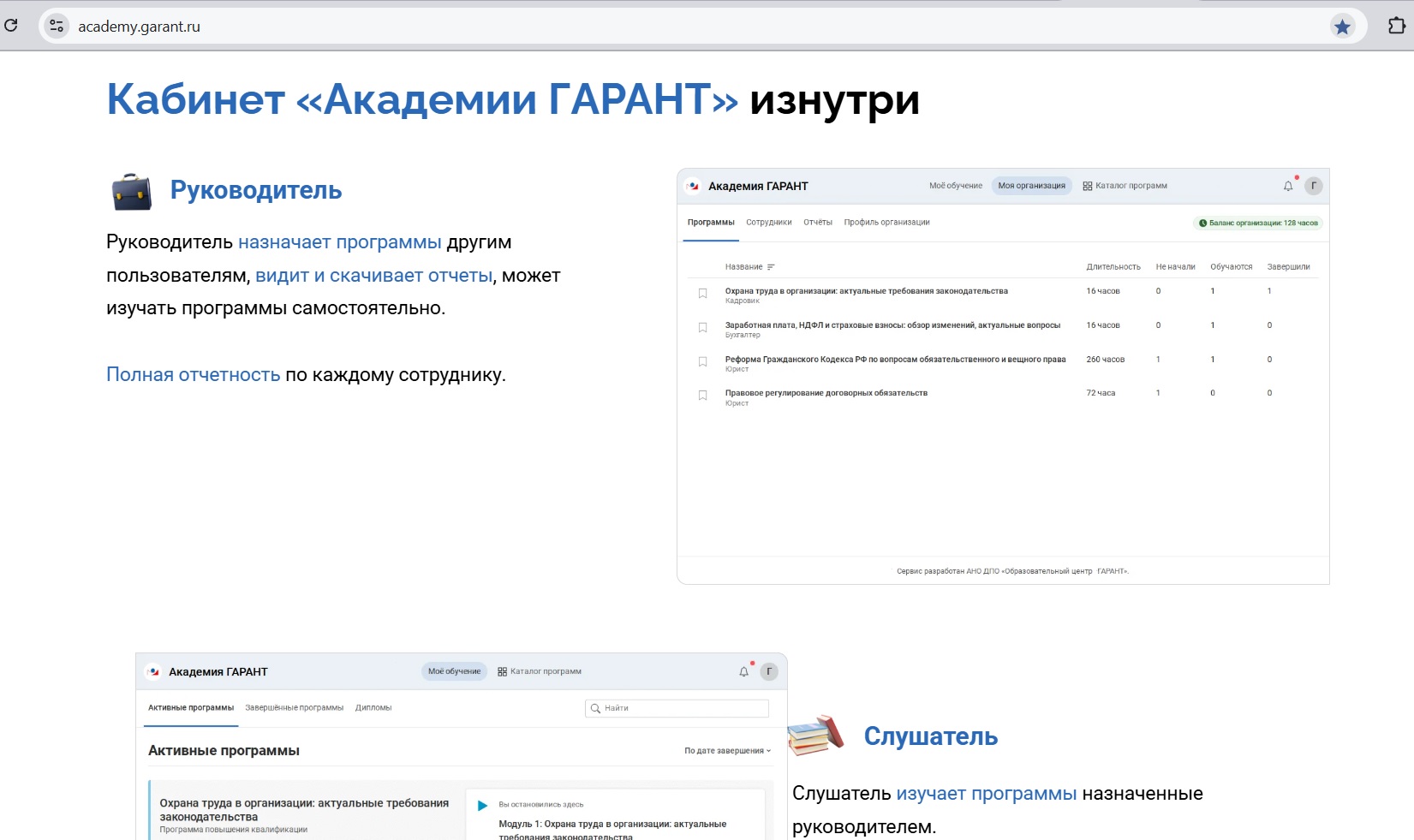

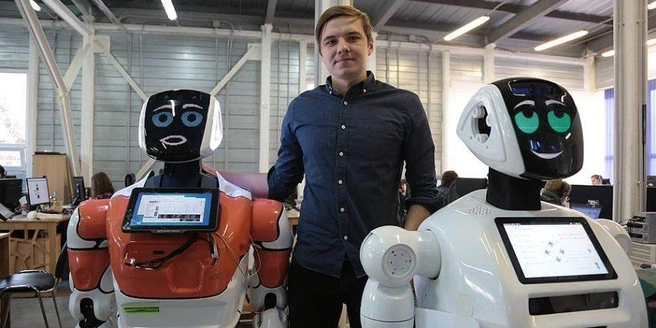

«Фонтанка» поговорила с человеком, который живет в России и сам профессионально делает сервисных роботов. Основатель и директор по развитию компании Promobot Олег Кивокурцев подсказал сенатору Кутепову несколько поправок и уточнил, в каком случае технике лучше не перечить.

— Олег, сенаторы решили вписать роботов в законодательство. И сразу делят их на «людей» и «чиновников». Автор законопроекта Андрей Кутепов предлагает разделить роботов на два типа: гражданские и служебные. «Гражданский робот — робот, деятельность которого направлена на реализацию частных интересов, оборот которого регулируется гражданским законодательством. Служебный робот — робот, деятельность которого направлена на реализацию интересов государства и общества, вовлеченный в сферу деятельности институтов публичной власти», — цитирует ТАСС документ. Можете объяснить обывателю, в чём смысл?

— Смысл в разделении роботов, в принципе, есть, поскольку в международной классификации их достаточно большое количество. Бытовые, домашние, сервисные, военные, медицинские, образовательные. Почему их разделяют? В их производстве и разработке используются абсолютно разные технологии. Например, в военных роботах активно используется вооружение. В домашних роботах используются механизмы малой механизации, для перемещения в замкнутом пространстве. В беспилотных летательных средствах — вообще технологии для авиации. В сервисных — система распознавания лиц и речи. Это всё по сути разные устройства, которые объединяет одно — автоматизация процессов. Классификация же автора законопроекта очень неконкретная. «Служебный робот — робот, деятельность которого направлена на реализацию интересов государства и общества, вовлеченный в сферу деятельности институтов публичной власти». Здесь могут быть и роботы-пылесосы. Ведь чистый пол в Госдуме — это в интересах государства. Сюда можно отнести и школьные умные колонки, которые устанавливаются «в интересах государства». И множество других бытовых и сервисных роботов.

— Так, может, цель как раз сконцентрировать сертификацию любой ерунды «по законам военного времени», то есть в руках силовиков? А каждая такая справка ведь может потребовать и оплаты «госпошлин».

— У меня тоже возникла мысль, что могут потребовать сертификацию всего и всех. Но я всё-таки не верю, что в 2021 году возможна подобного рода инициатива. Иначе это просто может погубить индустрию на корню. А сейчас она только формируется. Наоборот, надо давать максимальные возможности всем стартапам, которые предлагают прорывные идеи, ведь через 5–15 лет они станут стандартами. Вот тогда и можно будет классифицировать. А пока это преждевременно и опасно. Любая подобного рода ограничительная мера может всё погубить.

— То есть на самом деле речь про то, что не все роботы обязаны подчиняться общим правилам, если так нужно государству? Терминаторов гражданским не дадут?

— Действительно, есть логика в том, чтобы некоторых роботов отнести к «государственным». А именно роботов для МЧС, военной промышленности. Но бытовые должны быть доступны как военным, так и гражданским. И здесь будет самая большая дилемма, как это классифицировать. Какие органы подключать к стандартизации.

— Каких правил сегодня не хватает роботам для гражданских? Вам как производителю что нужно от законодателей?

— Сегодня робототехника регулируется стандартными правилами электроприборов. Это регламенты по электробезопасности, химической, механической безопасности, правила авиаперевозок и эксплуатации электроприборов. В целом законодательство достаточно продуманное. Но есть единственный момент, где недостаточно уделено внимание устройствам, — механическая безопасность. Поскольку роботы могут перемещаться, избегая столкновений, то здесь ответственность полностью ложится на производителя, на собственника устройства, в случае если пользователь в торговом центре неправильно взаимодействует с роботом. Если человек бросился под колёса автомобиля сам, то, конечно же, он сам и виноват в последствиях. Но если же человек бросится под колёса робота, то виноват собственник. И вот здесь нужно прописать, добавить, что при соблюдении всех норм с точки зрения эксплуатации правил использования роботов, всех систем навигации, допустимо, что ущерб может лежать на третьем лице, если он самостоятельно решил попасть под машину. То есть если человек специально подставил ногу перед огромной моющей машиной, то это должна быть его ответственность, а не ответственность производителей.

И второй важный момент — приватность. Сегодня персональные роботы все оснащены камерами. Нужно ослабить требования закона о персональных данных в части использования таких роботов, поскольку к ним требования такие же, как к системам видеонаблюдения, а назначение другое и техническая сторона другая. Нужно снизить здесь давление на робототехнику.

— У нас сами органы государственной власти пока боятся роботов. Слышали историю про учёных с Кавказа, которые предложили робота-черепаху для разгона демонстраций? Силовики говорят, что им такое не надо.

— Силовики такие устройства не эксплуатируют не потому, что им не надо, а потому что устройство должно соответствовать определённым критериям. Оно должно быть доступным по цене, должно быть надёжным. Пока робочерепаха этим требованиям не соответствует. Но если разработчики его всё-таки сделают, успешно проведут полевые испытания, то и у них есть шансы стать поставщиками.

— Это пример машины, информация о которой не будет укладываться в декларируемый принцип законопроекта о «безопасности личности» и «открытости информации о технологиях»?

— Робот-черепаха таковой машиной не является (заявляется, что робот сможет разгоняться до 50 км в час, стрелять быстротвердеющей пеной и сетками для пленения протестующих. — Прим. ред.). И в принципы о безопасности укладывается, как и в принципы открытости информации о технологиях. Поскольку, вообще-то, технические характеристики устройства были размещены в открытом доступе, в публичном поле. Единственное, что пугает органы власти в вопросах эксплуатации этой техники, это её неготовность и преждевременный старт диалога, до возникновения прототипа.

— Законопроект предлагает ввести «классы опасности роботов». Вы бы к чему привязывали эту самую опасность? К механическому потенциалу изделия (может поднять человека, отдавить ему ногу, перемещать оружие и применять его) или к «умственному потенциалу», когда машина сама будет решать, как ей поступать?

— Я бы сегодня ограничивался только механической опасностью изделия. И здесь бы обратился к опыту автомобилестроения, станкостроения, где эти классы есть. Я бы исходил из их методик. Опасность умственного потенциала роботов пока вообще нельзя описать, поскольку у роботов вообще нет сознания. Никак не посчитать эту опасность. Все роботы — набор алгоритмов. Об опасности в этом смысле говорить рано.

— Можете объяснить как профессионал, почему законодатель вводит запрет на оборот в РФ роботов, которые обладают возможностью самостоятельно принимать решения и которым намеренно придали свойства, позволяющие использовать их вместе с оружием, боеприпасами и взрывчатыми веществами? И одновременно Россия вместе с Китаем, США, Индией и Великобританией на прошлой неделе в Женеве на 6-й конференции ООН заблокировали введение международных правил защиты людей от роботов-убийц, принимающих решения с минимальным участием человека или без него?

— Сегодня не существует ни одного робота, ни одного устройства, которое способно самостоятельно принимать решение. Для самостоятельного принятия решения необходимо, чтобы объект имел сознание, а никто пока даже не понимает, что такое сознание, как оно устроено. Человеческий мозг изучен не более чем на 7%. Это только в фильме «Превосходство» с Джонни Деппом герой разобрался, как устроен человеческий мозг. Там — да. Но это фантастика. Изучением мозга занимается в том числе такая наука, как когнитивистика. И вот в тот момент, когда мы поймём, как работает человеческий мозг, возможно, мы сможем подойти к вопросам именно самостоятельного принятия решения машинами.

Так что это громкий заголовок. Он неправильный. На законодательном уровне не должно быть таких ошибок. Но я понимаю, о чём речь. Сегодня в военных роботах запрещено, чтобы робот производил выстрел. Едет автономный танк, производит наведение, но решение о выстреле принимает человек. Запрещено использовать автоматическое решение, потому что не существует систем распознавания человека с точностью более 90%. Многие стараются, но всё равно не удаётся. Это значит, что каждый десятый выстрел будет либо по мирному жителю, либо по своим. Этого допускать нельзя. В этой редакции это звучит разумно. Мы сами являемся авторами соответствующего законопроекта вместе с Илоном Маском, мы направляли письмо в ООН именно с просьбой об этом. В такой формулировке решение правильное, но стоит отметить, что это не самостоятельное принятие решения. Так и написать — автоматическое произведение выстрелов.

— Я на днях шёл по нечищеной улице и увидел застрявшую в снежной каше бабушку-инвалида на электрической коляске. Пришлось тащить её до нужного ей банкомата. А потом поднимать её на руках по ступенькам, потому что иначе никак, нет ни лифта, ни сотрудников. Законопроект Кутепова даст военным защиту для их машин-убийц или, скорее, всё же даст бабушке помощника, который облегчит её ежедневное мучение?

— Законопроект Кутепова не даст никому и ничего. Он даст правила, по которым будут создаваться как машины-убийцы, так и помощники бабушек, и автономные дроны, и роботы-консультанты. Это только первый шаг. В нём будет масса изменений в будущем. ПДД придумали в начале прошлого века, а к концу века они полностью поменялись. Возможно, этот законопроект станет основой правил, которые будут работать через 100 лет.

— Россия сегодня на каких позициях с точки зрения способностей отечественных роботов? Если вдруг встретишь в подъезде вашего робота, навряд ли испугаешься так, как если бы за углом оказался робот от британских коллег из Engineered Arts.

— Робототехника отлично развивается и во всём мире, и в России. У нас есть отличные игроки рынка в области образовательной робототехники. Компания TRIK из Санкт-Петербурга (TRIK Studio — среда программирования, позволяющая решать задачи как с помощью последовательности картинок, так и сложного текстового языка. — Прим. ред.). Есть отличные компании в области промышленной робототехники. Есть компания RCML, которая делает код для таких роботов. Есть компания ExoAtlet, которая делает медицинские экзоскелеты. Есть компания «ПромоБот» — крупнейшая в Европе по производству сервисных роботов. Есть компания VisionLabs, которая делает программное обеспечение с наивысшей точностью распознавания объектов. Их решение работает для распознавания оплаты проезда в метро по лицу. Есть компания «СМП Роботикс», которая делает одних из лучших охранных роботов. И множество других хороших компаний в России. И они на хороших позициях на мировом рынке.

Что же касается Engineered Arts, я не буду лукавить и скажу, что, пожалуй, если и нашего робота встретишь в подъезде, можно тоже испугаться. Здесь и сейчас идёт настоящее противостояние, похожее на космическую гонку. Все стараются сделать максимально похоже на человека. Стараются и российские разработчики. И не только мы. «Нейроботикс» у нас ещё таких роботов делает. Американцы, китайцы, британцы. Кто первый создаст первого робота, полностью похожего на человека, тот завоюет весь рынок. Поскольку, согласно исследованию «зловещей долины» робототехники, лучше всего воспринимаются именно такие машины.

— Может быть, именно этим положением РФ на фоне других стран объясняется запрет на выдачу лицензий на использование роботов «иностранным агентам» или компаниям, которые контролируются иностранцами?

— Именно этого положения пока ещё нет. Но не исключаю, что всё будет развиваться и прирастать в том числе и такими пунктами. Не исключено, что появится пункт про иностранных агентов в реальности.

— Лицензии на право использования робота — скорее зло или благо для развития отрасли?

— Если мы говорим о роботе-минёре, роботе для патрулирования, МЧС и прочих — это необходимость. А если мы говорим про домашних, бытовых и прочих, то здесь лицензия не нужна. Всё зависит от типа опасности. Если опасности нет, лицензия — зло.

— Робот может заменить законодателя? Когда сможет? Мы даём ему в программе тексты законов, даём ему критерии для разных вариантов реакции на запрос общества — и он работает.

— Законотворчество делится на две вещи. Первая — аналитика. Исследование судебной, уголовной практики, общественного мнения. И вторая история — творческая. Когда человек на основе здравого смысла, жизненного опыта и экспертизы принимает те или иные решения. С первым пунктом робот, безусловно, справится лучше всего. В Северной Европе подобного рода решения уже используются. Они логичны. Стоит снизить скорость до 60 км в час. Почему? Много ДТП. Идёшь и считаешь. Робот этот процесс существенно ускоряет. Однако сами законы роботы принимать не могут, у них отсутствует творческая составляющая. Пока они сами законы принимать не могут. Тот же смысл с военным роботом, который не решает, когда делать выстрел.

— Есть этический вопрос про искусственный интеллект. Развивая его, мы фактически обнуляем заслуги человека — ведь машина теперь может создавать такие же классные картины и такую же классную музыку. Стоит ли ограничивать эксперименты в этой сфере?

— Пока рано говорить, что мы обнуляем заслуги человека. Сегодня машина не может творить. Максимум она может повторять. Если в нейронную сеть загрузить 1 000 картинок импрессионистов, возможно, она сможет их повторить. Но искусство — это постоянно возникающие новые веяния. И на это машины не способны. Когда же мы научимся воспроизводить сознание в машине, нас будут волновать другие вопросы. Например, решением в этом случае могло бы стать создание обязательной красной кнопки, которая могла бы полностью остановить искусственный интеллект. Но задумываться об этом рано. Риска обнуления человека пока нет.

— Смотря какого человека. Олег, как истории вроде кибер-безопасника Сачкова, который записывает видео «на случай своего убийства», влияют на привлекательность киберспециальностей и навыков работы с цифровым миром? Или современной молодёжи на это наплевать уже совершенно?

— Я думаю, что молодёжь сейчас руководствуется двумя критериями. Первое — финансовое благополучие. Второе — интересная работа. В противном случае не было бы таких профессий, как шахтёр, полицейский, пилот. Поскольку профессии эти опасные, но высокооплачиваемые и интересные. Как минимум пилот — точно интересная (улыбается). Молодёжь дальше сделает один вывод: кибербезопасность — такое направление, где нужно быть тише воды и ниже травы. Чем ты ярче сияешь, тем больше причин и способов к тебе подобраться и на тебя напасть. Даже не то чтобы напасть, но повлиять. Сачков, возможно, в этом и допустил ошибку. Публично говорил о своих планах. Делал это в многомиллиардной индустрии. Он называл имена. Будущие специалисты должны взять это на заметку. Вообще ситуацию с Сачковым я для себя лично воспринимаю с большой грустью и печалью. Я знаю Сачкова. Очень его уважаю. Очень переживаю. Надеюсь, что скоро всё разрешится и его выпустят.

Леонид Лобанов, специально для «Фонтанка.ру».

Олег Кивокурцев родился и вырос в Перми. В 2013 году окончил Пермский политех по специальности «инженер-конструктор», в 2017-м там же окончил аспирантуру. В 2013 году втроем с одногруппниками сделал робота-снегоуборщика. Он стал знаменит на YouTube, после чего машину приобрёл покупатель из Чехии за $ 3 тыс. Первый «офис» компании был в гараже. В дальнейшем компания стала делать роботов для корпоративного применения. В 2015 году робот Promobot V.2 впервые отправился за пределы России — в Казахстан. В 2016 году Promobot становится портфельной компанией ФРИИ. Фонд развития интернет-инициатив инвестировал в производство роботов 150 млн рублей. С 2015 года компания произвела более 1 тыс. роботов, а география их поставок расширилась до 42 стран.